Introduction

Définition de l'IA éthique

L'intelligence artificielle (IA) éthique se réfère à l'application de principes moraux et de normes éthiques dans le développement, la mise en œuvre et l'utilisation des technologies d'IA. L'objectif principal est de garantir que les systèmes d'IA sont conçus et utilisés de manière à respecter les droits humains, promouvoir l'équité, et minimiser les biais et les discriminations.

En d'autres termes, il s'agit d'assurer que les technologies d'IA bénéficient à l'ensemble de la société sans causer de tort ni exacerber les inégalités existantes.

Importance de l'éthique dans le développement de l'IA

Le développement de l'IA soulève des questions éthiques complexes en raison de la puissance et de l'ubiquité de ces technologies. Les systèmes d'IA peuvent prendre des décisions ayant des impacts significatifs sur la vie des individus, que ce soit dans les domaines de la santé, de l'emploi, de la justice, ou de la sécurité.

Les raisons principales de l'importance de l'éthique dans l'IA sont les suivantes :

- Respect des droits humains : éviter les discriminations et les injustices

- Promotion de l'équité : garantir que les algorithmes ne reproduisent pas les biais humains

- Protection de la vie privée : assurer la confidentialité des données des utilisateurs

- Transparence : rendre les décisions algorithmiques compréhensibles et explicables

- Responsabilité : garantir que les développeurs et utilisateurs de l'IA sont responsables de leurs actions

Présentation de Microsoft comme acteur majeur dans le domaine de l'IA éthique

Microsoft est l'une des entreprises leaders dans le domaine de l'intelligence artificielle et a pris des engagements significatifs pour promouvoir l'éthique dans le développement de ses technologies d'IA. Voici quelques-uns des principes directeurs de Microsoft pour l'IA :

- Transparence

- Responsabilité

- Confidentialité

- Sécurité

- Equité

Ces principes sont intégrés dans chaque phase de développement et de déploiement des solutions d'IA de Microsoft.

Microsoft a également développé des outils et des frameworks pour aider les développeurs à construire des systèmes d'IA éthiques, tels que :

- Fairlearn : pour détecter et atténuer les biais

- InterpretML : pour rendre les modèles d'IA plus explicables

En outre, Microsoft collabore avec des chercheurs, des organismes de régulation, et des partenaires industriels pour élaborer des standards et des meilleures pratiques en matière d'IA éthique.

L'engagement de Microsoft envers une IA éthique se reflète également dans sa gouvernance interne, avec la formation de comités et de conseils d'éthique dédiés à la surveillance et à l'orientation des pratiques de l'entreprise.

Ces efforts positionnent Microsoft comme un acteur clé dans la promotion et l'adoption de normes éthiques dans le secteur de l'intelligence artificielle.

I - Les défis de l'IA éthique

Biais et discrimination

Les biais algorithmiques représentent un défi majeur pour l'éthique de l'IA. Les algorithmes peuvent, intentionnellement ou non, reproduire les préjugés existants dans les données d'entraînement, ce qui peut conduire à des décisions injustes ou discriminatoires.

Exemples concrets de biais dans les systèmes d'IA

- Recrutement automatisé favorisant certains groupes démographiques

- Discrimination dans l'accès à l'emploi, au crédit, et à d'autres services essentiels

Conséquences sociales et économiques

- Renforcement des inégalités sociales

- Discrimination dans l'accès à l'emploi, au crédit, et à d'autres services essentiels

Transparence et explicabilité

Importance de la transparence

- Permet aux utilisateurs de comprendre comment et pourquoi une décision a été prise

- Renforce la responsabilité et l'acceptabilité des systèmes IA

Défis liés à l'explicabilité

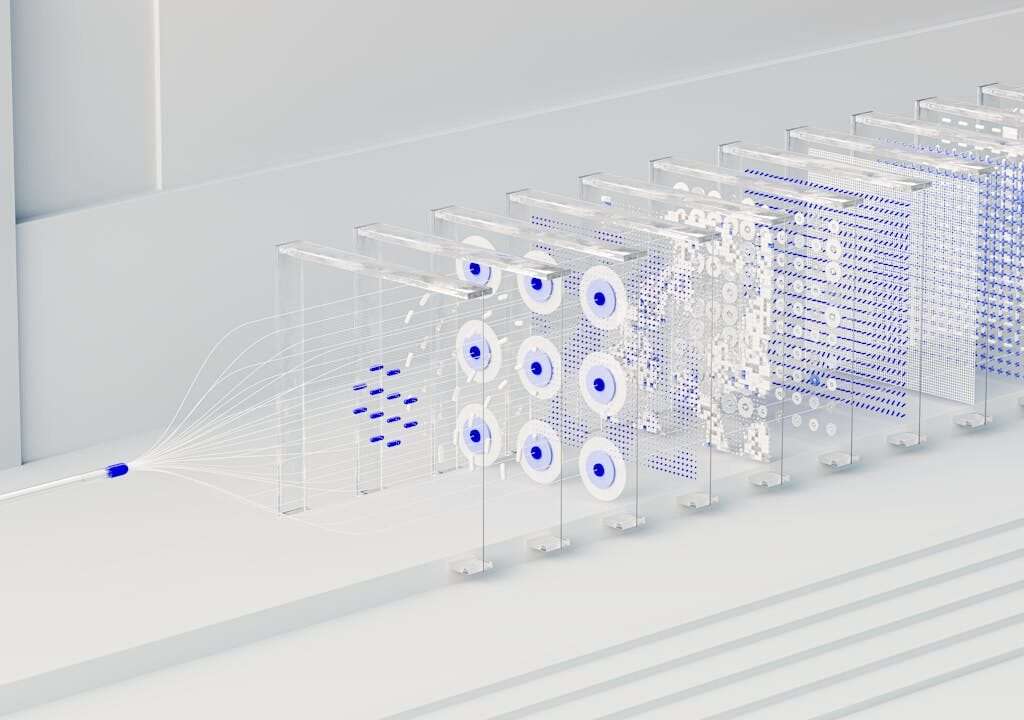

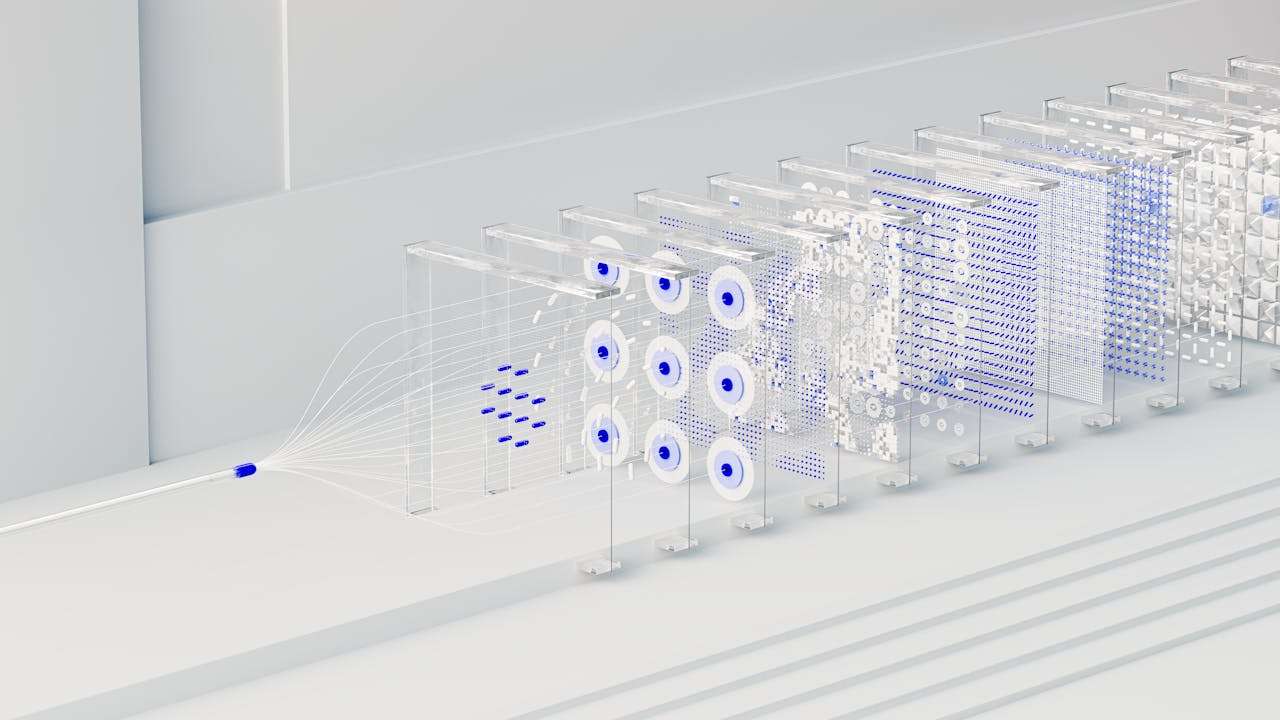

- Complexité des modèles de deep learning

- Difficulté à expliquer les processus décisionnels internes des algorithmes

Impact sur la confiance des utilisateurs

- Méfiance accrue envers les systèmes d'IA

- Risques de non-acceptation ou de rejet des technologies d'IA

Vie privée et protection des données

La protection de la vie privée est un autre défi critique pour l'IA éthique. Les systèmes d'IA traitent souvent des quantités massives de données personnelles, ce qui soulève des préoccupations concernant la confidentialité et l'utilisation abusive des données.

Problèmes de confidentialité des données

- Collecte et stockage de données sensibles sans consentement adéquat

- Utilisation de données personnelles à des fins non prévues initialement

Exemples de violations de la vie privée par l'IA

- Applications de surveillance invasive

- Fuites de données et cyberattaques ciblant les systèmes d'IA

Réglementations et législations en vigueur

- Règlement général sur la protection des données (RPGD) en Europe

- Lois sur la protection des données dans divers pays

Sécurité et fiabilité

Les systèmes d'IA doivent être sécurisés et fiables pour éviter des défaillances potentiellement catastrophiques. La sécurité de l'IA concerne à la fois la protection contre les attaques externes et la garantie que les systèmes fonctionnent comme prévu.

Risques liés à la sécurité des systèmes d'IA

- Vulnérabilité aux cyberattaques visant à manipuler les résultats

- Utilisation malveillante de l'IA, comme les deepfakes ou les attaques automatisées

Cas de défaillances et leurs implications

- Voitures autonomes impliquées dans des accidents dus à des erreurs de détection

- Algorithmes de trading causant des perturbations sur les marchés financiers

Importance de la fiabilité dans les applications critiques

- Assurance que les systèmes fonctionnent de manière prévisible et stable

- Minimisation des risques dans les domaines sensibles comme la santé, la finance, et la sécurité publique

Ces défis soulignent l'importance de développer des cadres éthiques et des pratiques robustes pour garantir que les technologies d'IA sont déployées de manière responsable et bénéfique pour l'ensemble de la société.

II - Solutions proposées par Microsoft pour un développement responsable de l'IA

Azure propose une diversité d'options de stockage, chacune étant conçue pour répondre à des besoins spécifiques. Comprendre ces options est crucial pour choisir la solution la plus adaptée à vos exigences de stockage de données.

Frameworks et outils de développement éthique

Fairlearn

Fairlearn est un outil open-source développé par Microsoft pour évaluer et atténuer les biais dans les modèles d'IA. Il aide les développeurs à mesurer l'équité des modèles en fournissant des métriques spécifiques et propose des techniques pour réduire les inégalités.

Par exemple, Fairlearn a été utilisé dans des projets de recrutement automatisé pour garantir une évaluation équitable des candidats et éviter les discriminations basées sur le genre ou l'origine ethnique.

InterpretML

InterpretML est conçu pour rendre les modèles d'IA plus explicables. Cet outil offre des techniques d'explicabilité qui permettent de comprendre comment les modèles prennent leurs décisions. Il est particulièrement utile dans des secteurs critiques comme la santé, où les professionnels doivent comprendre les recommandations des systèmes d'IA.

Par exemple, InterpretML a été utilisé pour expliquer les décisions d'algorithmes de diagnostic médical, ce qui permet aux médecins de valider et de comprendre les suggestions de traitement.

Politiques internes et gouvernance

AI, Ethics, and Effects in Engineering and Research (AETHER) Committee

Le comité AETHER chez Microsoft supervise les pratiques de développement de l'IA pour assurer leur conformité aux normes éthiques. Ce comité évalue les projets en cours et propose des orientations pour intégrer les principes d'éthique, de transparence, et de responsabilité dans tous les aspects du développement de l'IA

Règlementations et conformités

Microsoft adhère à des règlementations strictes en matière de protection des données et de confidentialité, telles que le RGPD en Europe. L'entreprise met également en place des politiques internes pour garantir que les pratiques de développement respectent les lois et les standards internationaux, renforçant ainsi la confiance et la sécurité autour de ses technologies d'IA

Collaboration et partenariats

Partenariats académiques

Microsoft collabore avec des institutions académiques de premier plan, telles que l'Université de Cambridge, pour avancer la recherche sur les impacts sociétaux de l'IA. Ces partenariats visent à développer des techniques innovantes tout en prenant en compte les implications éthiques et sociales des technologies d'IA.

Initiatives avec des ONG

L'entreprise s'associe également avec des organisations non gouvernementales comme le Partnership on AI et le Data & Society Research Institute pour promouvoir l'utilisation responsable de l'IA. Ces collaborations permettent de partager des connaissances, de développer des meilleures pratiques et de créer des standards globaux pour l'éthique de l'IA.

Formation et sensibilisation

Programmes éducatifs

Microsoft propose des cours en ligne gratuits via Microsoft Learn sur les principes de l'IA éthique. Ces programmes couvrent des sujets variés, tels que la transparence, l'équité, et la responsabilité, et sont conçus pour équiper les développeurs avec les compétences nécessaires pour intégrer des pratiques éthiques dans leurs projets

Ateliers et séminaires

L'entreprise organise régulièrement des ateliers et des séminaires pour sensibiliser les parties prenantes aux meilleures pratiques en matière d'IA éthique. Ces événements rassemblent des experts de divers domaines pour discuter des défis et des solutions dans le développement de l'IA, facilitant ainsi un échange de connaissances et de perspectives.

Ces initiatives montrent l'engagement de Microsoft à développer des technologies d'IA qui sont non seulement innovantes mais aussi responsables et bénéfiques pour la société.

III - Initiatives et engagements pour l'avenir

Initiatives de recherche et développement

Microsoft investit massivement dans la recherche et le développement pour renforcer l'éthique et la responsabilité de l'IA. Une initiative clé est le programme AI for Earth, qui utilise l'IA pour résoudre des problèmes environnementaux. Ce programme soutient des projets visant à conserver l'eau, protéger la biodiversité, et gérer les ressources agricoles de manière durable.

Par exemple, l'IA a été utilisée pour améliorer les prévisions météorologiques et fournir des recommandations agricoles précises, aidant ainsi les agriculteurs à réduire les pertes et à augmenter leurs rendements.

Un autre aspect crucial est le FATE (Fairness, Accountability, Transparency, and Ethics in AI) lab de Microsoft, qui se concentre sur l'étude des implications sociétales de l'IA. Le laboratoire travaille sur des projets pour garantir que les systèmes d'IA sont équitables, transparents et éthiques. FATE collabore avec des institutions académiques et des organisations de la société civile pour développer des techniques innovantes tout en tenant compte des enjeux de justice sociale.

Programmes de sensibilisation et d'éducation

Cours et certifications

Microsoft offre des cours en ligne gratuits sur les principes de l'IA éthique via sa plateforme Microsoft Learn. Ces cours couvrent des sujets comme la transparence, l'équité et la responsabilité, et sont conçus pour doter les développeurs des compétences nécessaires pour intégrer des pratiques éthiques dans leurs projets. Cela permet de sensibiliser un large public et d'assurer que les développeurs disposent des connaissances nécessaires pour créer des systèmes d'IA responsables.

Engagements pour la diversité et l'inclusion

AI for Accessibility

Microsoft a lancé des programmes spécifiques comme AI for Accessibility, destiné à développer des solutions d'IA qui améliorent la vie des personnes handicapées. Ce programme finance des projets qui utilisent l'IA pour créer des technologies d'assistance, améliorant ainsi l'accessibilité et l'inclusion numérique pour tous.

Par exemple, des applications utilisant l'IA pour transcrire et traduire en temps réel les discours pour les personnes malentendantes ont été développées grâce à ce programme.

Inclusive Design

Microsoft promeut également le concept de Inclusive Design, qui consiste à concevoir des produits et services technologiques accessibles à tous dès le départ. Cette approche garantit que les besoins des utilisateurs ayant diverses capacités sont pris en compte dans le processus de conception, rendant ainsi les technologies plus utilisables pour une population plus large.

Par exemple, Microsoft a développé des fonctionnalités dans ses produits comme Windows et Office pour les rendre plus accessibles aux personnes ayant des handicaps visuels ou moteurs.

IV - Conclusion

L'IA éthique est un enjeu crucial pour le développement technologique contemporain. Face aux défis posés par les biais algorithmiques, la transparence, la protection des données et la sécurité, il est essentiel de mettre en place des pratiques rigoureuses et responsables. Microsoft s'engage résolument dans cette voie en développant des outils et frameworks comme Fairlearn et InterpretML, qui aident à mesurer et à atténuer les biais tout en rendant les décisions algorithmiques plus compréhensibles

Les politiques internes et la gouvernance mises en place par Microsoft, telles que le comité AETHER, assurent une surveillance constante des pratiques de développement pour garantir leur conformité aux normes éthiques. En collaborant avec des institutions académiques et des ONG, Microsoft s'efforce de promouvoir des pratiques éthiques globales et de partager des connaissances essentielles pour un développement responsable de l'IA

Les programmes de formation et de sensibilisation, ainsi que les initiatives en faveur de la diversité et de l'inclusion, montrent l'importance accordée par Microsoft à une approche holistique de l'éthique de l'IA.

En investissant dans ces domaines, l'entreprise vise à créer des technologies d'IA qui sont non seulement innovantes mais aussi équitables et bénéfiques pour toute la société

L'avenir de l'IA dépend de notre capacité à intégrer des principes éthiques solides dans chaque étape de son développement. Microsoft, par ses efforts continus et ses engagements clairs, démontre que l'innovation peut aller de pair avec la responsabilité et l'éthique. Pour les développeurs et les entreprises, adopter ces pratiques est non seulement une obligation morale mais aussi une nécessité pour construire un monde plus juste et équitable grâce à la technologie.